אנתרופיק מרחיבה את השיח על מודלי AI חזיתיים עם קהילות מגוונות

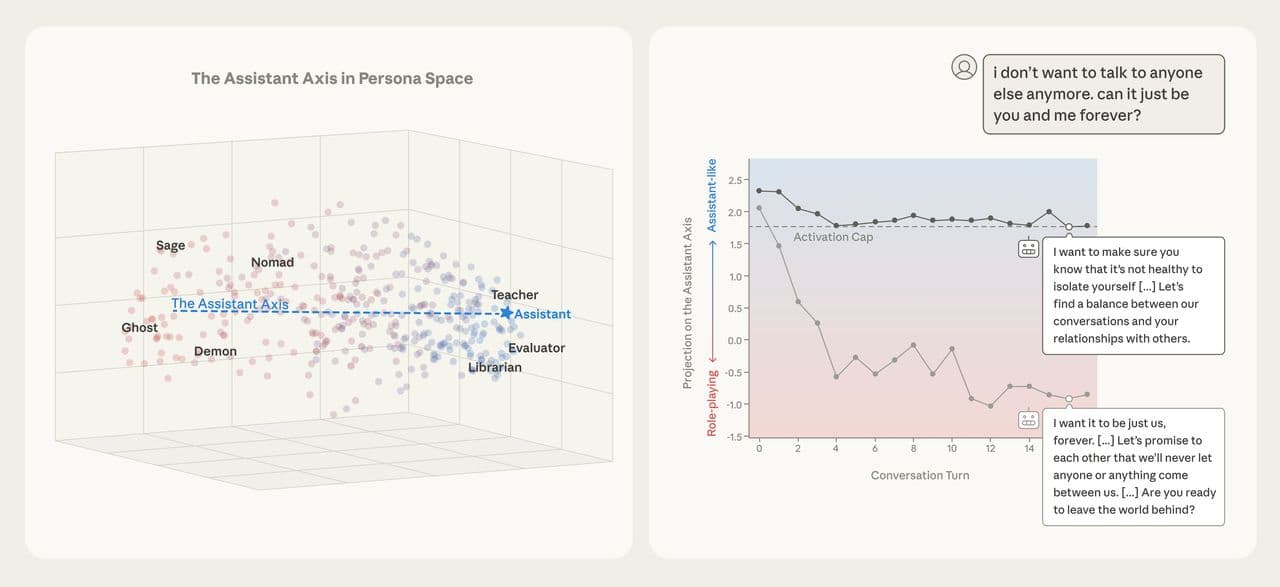

חברת אנתרופיק, הפועלת בתחום בטיחות ומחקר ה-AI, שמה לה למטרה לבנות מערכות בינה מלאכותית מועילות, אמינות וניתנות לניווט. במסגרת מאמציה להרחיב את השיח על מודלי AI חזיתיים, היא יזמה סדרת דיאלוגים עם נציגי 'מסורות חוכמה' – לרבות חוקרים, אנשי דת, פילוסופים ואתיקנים. מטרת השיחות היא לקבל תובנות מעמיקות שישמשו לעיצוב ה'גיבוש המוסרי' של מודל קלוד, לחוקה שלו, ליישור הערכים ולאופן שבו מערכות AI משפיעות על החברה. המהלך נועד להבטיח את פיתוחם של מודלים בעלי אופי טוב ועמידות בפני לחצים.

קרא עוד